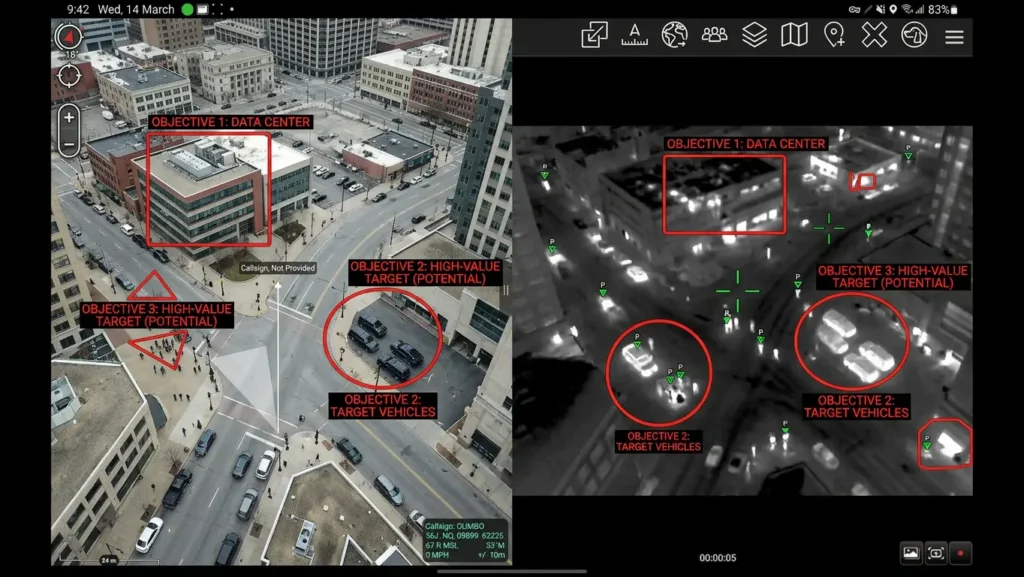

Hay guerras que se libran en el territorio, y otras que empiezan mucho antes, en capas de procesamiento que casi nunca vemos. Antes del misil, antes del dron, antes de la explosión, y antes de segar la vida de personas que estaban en un lugar intentando seguir con sus vidas, hay una cadena de traducciones: imágenes satelitales convertidas en patrones, llamadas telefónicas reducidas a metadatos, movimientos humanos interpretados como anomalías, probabilidades o amenazas. En esa zona opaca, donde la percepción se automatiza y la decisión se acelera, la inteligencia artificial se ha convertido en infraestructura operativa de la guerra contemporánea.

Pero esa infraestructura no es abstracta. Produce personas muertas, cuerpos heridos, animales devastados, hospitales alcanzados, recursos vitales destruidos y ciudades enteras sometidas a una lógica de cálculo. En la guerra actual contra Irán, Reuters recogía esta semana que la organización HRANA elevaba a 3.099 las personas muertas en Irán, de las cuales 1.351 serían civiles, incluyendo 207 menores. La OMS, por su parte, había confirmado 18 ataques contra instalaciones sanitarias iraníes desde el inicio del conflicto el 28 de febrero. Hablar de IA en este contexto no es hablar de innovación: es hablar de la aceleración técnica de la violencia y de cómo esa aceleración reorganiza la escala del daño.

La actual guerra contra Irán vuelve a poner esta cuestión en primer plano no solo por su intensidad militar, sino porque confirma hasta qué punto los sistemas de IA se han integrado en la cadena de inteligencia, clasificación y targeting. Associated Press informó de que el Pentágono estaba utilizando herramientas avanzadas de IA para filtrar enormes volúmenes de datos en segundos. Y Reuters reveló, a partir de documentos del litigio entre Anthropic y el Departamento de Defensa, que herramientas basadas en Claude habrían permanecido activas en operaciones militares incluso después de que la compañía intentara retirarlas, mientras altos cargos advertían de que imponerles restricciones rápidas podía poner en riesgo misiones en curso.

Lo importante aquí es no confundir escenarios. Los sistemas Habsora o The Gospel, Lavender y Where’s Daddy no están documentados públicamente como herramientas del frente actual contra Irán, sino sobre todo en Gaza. Y precisamente por eso Gaza debe aparecer en este artículo: porque allí se hizo visible, con una claridad sin precedentes, una lógica que hoy se expande. Investigaciones de +972 Magazine, Local Call, Human Rights Watch y The Guardian describieron cómo esos sistemas servían para generar listas de edificios a atacar, clasificar personas como objetivos potenciales y rastrear su presencia en el hogar familiar para facilitar el momento del bombardeo. Personas que estaban en casa, con sus familias, intentando seguir con sus vidas. Gaza no es aquí una digresión: es el laboratorio donde la guerra algorítmica se ensayó, se normalizó y adquirió la forma exportable que hoy se despliega en otros frentes.

Desde ahí, la pregunta ya no es si la IA participa en la guerra, sino qué tipo de guerra se vuelve posible cuando la identificación del objetivo, la lectura de la amenaza y la compresión del tiempo de decisión pasan a depender de sistemas opacos, entrenados sobre datos incompletos, sesgados o descontextualizados. Y es justamente en ese punto donde el arte contemporáneo deja de ser comentario y empieza a funcionar como una forma de contrainteligencia cultural: una práctica capaz de abrir la caja negra, ralentizar la percepción y devolver espesor humano a lo que la máquina había reducido a señal.

Una integración demasiado profunda para ser apagada

Lo más inquietante de esta nueva fase no es únicamente que la inteligencia artificial participe en la guerra, sino la profundidad con la que ya ha sido absorbida por su infraestructura. Durante años, la narrativa dominante presentó estos sistemas como herramientas auxiliares: apoyos técnicos para analizar más datos, detectar patrones con mayor rapidez o asistir en la toma de decisiones. Pero esa descripción se ha quedado corta. Lo que estamos viendo es otra cosa: una integración estructural de modelos algorítmicos en la cadena misma de percepción, interpretación y acción militar.

En la guerra actual contra Irán, esa integración ya no puede leerse como hipótesis. Según Reuters, la disputa entre el Pentágono y Anthropic surgió precisamente porque la compañía se negó a relajar ciertas salvaguardas ligadas al uso de Claude en vigilancia masiva y armas autónomas letales. Al mismo tiempo, los propios documentos del litigio sostienen que las herramientas de Anthropic seguían presentes en operaciones militares recientes, y cargos del Departamento de Defensa admitieron que imponer restricciones rápidas podía poner en riesgo misiones en curso. El problema no es solo que un modelo esté disponible. El problema es que, una vez incrustado en la infraestructura, retirarlo deja de ser un gesto técnico simple y se convierte en una crisis operativa.

Eso es exactamente lo que Gaza ya había anticipado. Allí, las investigaciones sobre Lavender, The Gospel y Where’s Daddy? mostraron una cadena de violencia en la que la automatización no sustituía por completo al humano, pero sí moldeaba el marco de decisión con una intensidad tal que la supervisión quedaba reducida, acelerada o banalizada. La máquina no eliminaba la responsabilidad humana; la redistribuía dentro de un sistema diseñado para producir objetivos a escala. Personas convertidas en puntuaciones. Hogares convertidos en coordenadas. Vidas interrumpidas por correlaciones estadísticas que nadie revisó con suficiente cuidado.

Lo que hoy vemos en Irán no es una copia literal de esos sistemas, sino la consolidación de la misma racionalidad: una guerra que traduce la vida humana en patrones, puntuaciones y sospechas computables —y que delega en esa traducción la decisión sobre quién muere.

Gaza como laboratorio de la guerra algorítmica

Las tecnologías de guerra no aparecen de repente en un nuevo frente como si nacieran allí. Se ensayan, se prueban, se ajustan y se normalizan en otros lugares. Gaza hizo visible para una audiencia global algo que llevaba tiempo incubándose: la conversión del targeting en un proceso cada vez más automatizado, opaco y escalable.

En el caso de The Gospel/Habsora, lo que aparece es una fábrica de objetivos que incrementa drásticamente la cantidad de blancos disponibles para el bombardeo. En el caso de Lavender, la automatización se desplaza hacia la clasificación de personas como sospechosas o atacables. Y con Where’s Daddy? la lógica llega a un punto especialmente siniestro: el sistema señala cuándo ese objetivo entra en su casa, de modo que el hogar familiar deja de ser refugio y se convierte en coordenada operativa. El momento en que alguien vuelve con los suyos, el instante de mayor vulnerabilidad, queda marcado como la oportunidad táctica óptima.

Lo que estas revelaciones ponen en evidencia no es solo un problema técnico. Es un cambio de régimen perceptivo. La vida humana ya no aparece primero como biografía, contexto o relación, sino como señal, puntuación o probabilidad. Y una vez que esa traducción se vuelve habitual, el salto a otros teatros de guerra resulta mucho más corto. Ahí está una de las lecciones más duras de este presente: las guerras contemporáneas no solo destruyen territorios, también fabrican metodologías exportables.

El arte contemporáneo como contrainteligencia

Si la opacidad de estos sistemas es su mecanismo de poder —si funcionan precisamente porque no se ven, porque la cadena de decisión que produce muertos permanece fuera del campo perceptivo de quienes podrían cuestionarla—, entonces la intervención más urgente no es solo jurídica o política: es también perceptiva. Y ahí es donde el arte contemporáneo deja de ser comentario y empieza a funcionar como una forma de contrainteligencia cultural.

Muchas de las obras más relevantes de los últimos años no se limitan a representar la vigilancia o a denunciar la violencia. Operan de otro modo: hacen visible la infraestructura que el Estado y las plataformas prefieren mantener fuera de campo; devuelven escala física y emocional a violencias que suelen aparecer miniaturizadas en pantallas y mapas; rehumanizan el dato, mostrando que toda clasificación algorítmica está atravesada por sesgos, historias y exclusiones. No es poca cosa. En una época en la que la guerra se vuelve interfaz y la muerte se vuelve workflow, el arte puede devolver fricción, cuerpo y contexto. Puede recordarnos que la supuesta neutralidad técnica no es una propiedad de la máquina, sino una ficción política extremadamente útil.

Hacer visible lo que oficialmente no existe

Trevor Paglen y la infraestructura secreta

Trevor Paglen lleva años trabajando allí donde visión y secreto se rozan. En Limit Telephotography, utiliza telescopios de entre 1300 mm y 7000 mm para fotografiar paisajes que no pueden verse a simple vista. Esa técnica, próxima a la astrofotografía, le permite registrar bases e instalaciones ocultas a gran distancia. Lo importante es que las imágenes no prometen transparencia total: son borrosas, tensas, inestables. Y por eso mismo dicen la verdad del problema. Lo secreto no solo se oculta; produce las condiciones materiales de su propia invisibilidad.

En Hallucinations y en la serie Adversarially Evolved Hallucinations, Paglen desplaza el foco desde la infraestructura militar hacia la visión maquínica. Su método consiste en enfrentar una red generadora con otra red discriminadora para producir imágenes capaces de engañar al sistema entrenado para ver objetos. Lo fascinante aquí no es la rareza visual, sino la tesis política: los algoritmos no observan el mundo desde ninguna neutralidad. Ven desde los datasets, las taxonomías y las obsesiones culturales que les hemos dado. En otras palabras: la caja negra no empieza cuando un sistema selecciona un objetivo militar. Empieza mucho antes, cuando una cultura decide qué merece ser visto, cómo debe ser clasificado y qué desviaciones serán leídas como amenaza. Paglen no ilustra ese problema; lo materializa.

Subvertir la vigilancia, devolver escala al dron

En Hansel & Gretel, concebida por Jacques Herzog, Pierre de Meuron y Ai Weiwei para el Park Avenue Armory, el espacio se convierte en un laboratorio sensible de vigilancia. No se trata simplemente de una instalación sobre control social. Es una experiencia en la que el cuerpo del visitante queda absorbido por lógicas de seguimiento, rastreo y exposición. La obra vuelve palpable algo que hoy atraviesa tanto la ciudad conectada como el campo de batalla informatizado: ser visto es ya, en muchos casos, ser traducido.

En Camouflage, presentada en Four Freedoms Park, Ai Weiwei trabaja con la imaginería militar del camuflaje para abrir una reflexión más amplia sobre guerra, libertad y devastación. Su gesto resulta especialmente pertinente aquí porque desplaza la mirada desde el dispositivo hacia las vidas que quedan bajo él, incluidas aquellas —animales, afectos, hábitats— que la doctrina militar suele tratar como ruido de fondo. La obra nos obliga a salir del marco estrecho del objetivo y a pensar la violencia como destrucción de ecologías enteras: no solo de personas, sino de todo aquello que las rodeaba y sostenía.

James Bridle hace otra operación decisiva en Drone Shadow. Trazando la silueta de un dron a escala 1:1 en el espacio público, devuelve volumen y peso a una máquina que normalmente solo aparece como punto abstracto en una interfaz. La frase asociada a la obra sigue siendo demoledora: «The purpose of a drone is to be invisible.» Esa invisibilidad no es solo óptica. Es también moral y política. Si el dron y la red que lo sostiene permanecen fuera del campo perceptivo, la ciudadanía queda desarmada frente a ellos. Por eso Bridle insiste en hacer visible la infraestructura: porque quien no percibe la red no puede actuar dentro de ella. Y eso vale tanto para los UAV como para las plataformas algorítmicas que hoy procesan inteligencia y priorizan amenazas.

Investigar contra la versión oficial

Forensic Architecture y la imagen como prueba

Si Paglen trabaja en el borde de lo visible y Bridle devuelve escala al aparato, Forensic Architecture entra en otra zona crucial: la de la imagen como evidencia. En The Bombing of Rafah y en la investigación asociada a Black Friday, el colectivo reconstruyó cuatro días de bombardeos a partir de imágenes, metadatos, sombras, cronologías y análisis espacial. El resultado no fue solo una visualización impactante, sino una disputa material con la narrativa oficial sobre lo que ocurrió, cuándo, y a quiénes.

Aquí la arquitectura deja de ser decorado y se convierte en sensor. El espacio da testimonio. La nube de polvo, la orientación de una sombra, la secuencia de un vídeo amateur o la diferencia entre imágenes satelitales antes y después pasan a formar parte de una metodología que combate la niebla de guerra con una política de verificación. Y eso es fundamental en un tiempo en que los ejércitos reivindican precisión quirúrgica mientras externalizan cada vez más la percepción a sistemas automáticos que nadie puede auditar.

Lo que Forensic Architecture nos enseña es algo incómodo pero necesario: que la estética no tiene por qué ser lo contrario de la prueba. También puede ser una técnica de esclarecimiento. Una forma de construir verdad pública allí donde la velocidad, la saturación y la jerga militar buscan cerrar el sentido demasiado rápido.

Rehumanizar el dato

Joy Buolamwini, Caroline Sinders y Stephanie Dinkins

La guerra algorítmica no nace únicamente en el terreno militar. Se alimenta también de tecnologías civiles que ya ven mal, clasifican mal y jerarquizan mal. Por eso la crítica a la IA bélica no puede separarse de la crítica a la IA comercial, policial o corporativa. El sesgo que hace que un sistema no reconozca ciertos rostros y el sesgo que hace que un sistema clasifique ciertas vidas como amenaza potencial no son fenómenos distintos: comparten genealogía, comparten infraestructura y comparten las consecuencias de sus errores.

En AI, Ain’t I A Woman?, Joy Buolamwini convierte en poema visual la violencia de esa mala lectura. La Algorithmic Justice League describe la pieza como una respuesta artística a los daños de la IA, que aborda cómo figuras icónicas de mujeres negras son mal etiquetadas y mal generizadas por herramientas de análisis facial. Lo potente de Buolamwini es que no separa investigación y lenguaje sensible. Su trabajo demuestra que el sesgo no es una anomalía puntual del sistema, sino una huella estructural de quién diseña, quién etiqueta y quién queda fuera de la norma visual dominante. Cuando una máquina no sabe ver ciertos rostros, no solo falla técnicamente: reproduce una política de la invisibilidad.

Caroline Sinders, con Feminist Data Set, empuja la crítica un paso más allá. Su proyecto interroga cada fase del pipeline de aprendizaje automático: recogida de datos, etiquetado, entrenamiento, elección del modelo y diseño del sistema final. La pregunta que atraviesa el trabajo es tan simple como radical: ¿es feminista cada uno de esos pasos? ¿Es interseccional? ¿Qué sesgos contiene y cómo podrían desactivarse?

Stephanie Dinkins, por su parte, ofrece una respuesta todavía más situada con Not The Only One. La obra se presenta como un experimento para crear una memoria multigeneracional de una familia negra estadounidense desde la perspectiva de una inteligencia artificial entrenada con historias orales. En lugar de extraer valor de grandes datasets impersonales, Dinkins construye una entidad conversacional alineada con comunidades subrepresentadas en el sector tecnológico. Frente a la abstracción fría del dato, aquí la IA se convierte en archivo afectivo y memoria situada.

Lo que estas obras iluminan

Llegados aquí, quizá la cuestión ya no sea si el arte puede responder a la guerra algorítmica. La cuestión es más concreta: qué herramientas de percepción crítica nos deja. Y la respuesta, al menos en estas obras, parece clara. Nos dejan métodos para mirar de nuevo. Para sospechar de la neutralidad. Para devolver espesor humano a lo que la máquina comprimió en señal. Para recordar que toda promesa de eficiencia contiene también una política de exclusión, y que esa exclusión tiene rostros, nombres y familias que esperaban en casa.

Las víctimas de la guerra merecen nuestro dolor, sí. Pero merecen también que no apartemos la mirada de aquello que aceleró su muerte. Merecen que no aceptemos como paisaje la conversión de la vida en metadata, ni la reducción del juicio político a una cadena de correlaciones computables.

Si Gaza nos mostró el laboratorio y la guerra contra Irán nos muestra la expansión, el arte contemporáneo puede ayudarnos a leer el patrón antes de que termine por parecer natural. No va a detener un bombardeo. No va a desmilitarizar por sí solo la nube, el satélite ni el modelo. Pero sí puede hacer algo urgente: romper la naturalidad con la que estas tecnologías buscan instalarse en nuestra imaginación. Abrir la caja negra. Ralentizar la visión. Y devolvernos la única pregunta que hoy importa más que nunca: ¿qué dejamos de ver cuando una máquina ve por nosotros?